研究敦促将神经网络与大脑进行比较时要谨慎

神经网络是一种松散地模拟人脑组织的计算系统,构成了许多人工智能系统的基础,用于语音识别、计算机视觉和医学图像分析等应用。

在神经科学领域,研究人员经常使用神经网络来尝试模拟大脑执行的相同类型的任务,希望这些模型可以提出关于大脑本身如何执行这些任务的新假设。然而,麻省理工学院的一组研究人员敦促在解释这些模型时应更加谨慎。

在对 11,000 多个经过训练以模拟网格细胞(大脑导航系统的关键组件)功能的神经网络进行分析时,研究人员发现,神经网络只有在受到非常具体的约束时才会产生类似网格细胞的活动在生物系统中没有发现。

“这表明,为了获得网格单元的结果,研究人员训练了所需的模型,以使用特定的、生物学上不合理的实施选择来烘焙这些结果,”麻省理工学院前高级研究员 Rylan Schaeffer 说。

如果没有这些限制,麻省理工学院的团队发现很少有神经网络产生类似网格细胞的活动,这表明这些模型不一定能对大脑的工作方式产生有用的预测。

Schaeffer 现在是斯坦福大学计算机科学专业的研究生,是这项新研究的主要作者,该研究将于本月在 2022 年神经信息处理系统会议上发表。脑与认知科学教授、麻省理工学院麦戈文脑研究所成员 Ila Fiete 是该论文的资深作者。麻省理工学院物理学研究生 Mikail Khona 也是一位作家。

建模网格单元

数十年来,研究人员一直在使用神经网络来执行各种计算任务,它由数千或数百万个相互连接的处理单元组成。每个节点与网络中的其他节点具有不同强度的连接。当网络分析大量数据时,这些连接的强度会随着网络学习执行所需任务而改变。

在这项研究中,研究人员专注于模拟大脑网格细胞功能的神经网络,这些细胞存在于哺乳动物大脑的内嗅皮质中。与海马体中的位置细胞一起,网格细胞形成了一个大脑回路,帮助动物知道它们在哪里以及如何导航到不同的位置。

研究表明,只要动物处于特定位置,位置细胞就会触发,并且每个位置细胞可能对多个位置做出反应。另一方面,网格单元的工作方式非常不同。当动物在房间等空间中移动时,只有当动物位于三角形格子的一个顶点时,网格单元才会触发。不同的网格单元组创建尺寸略有不同的网格,它们相互重叠。这允许网格单元使用相对较少数量的单元对大量唯一位置进行编码。

这种类型的位置编码还可以根据给定的起点和速度预测动物的下一个位置。在最近的几项研究中,研究人员已经训练神经网络来执行同样的任务,这就是所谓的路径整合。

为了训练神经网络来执行这项任务,研究人员向其中输入了一个起点和一个随时间变化的速度。该模型基本上模仿了动物在空间中漫游的活动,并在它移动时计算更新的位置。随着模型执行任务,可以测量网络内不同单元的活动模式。每个单元的活动都可以表示为一种放电模式,类似于大脑中神经元的放电模式。

在之前的几项研究中,研究人员报告说,他们的模型产生的单元的活动模式与网格细胞的发射模式非常相似。这些研究得出结论,任何经过训练以执行路径集成任务的神经网络中都会自然出现类似网格单元的表示。

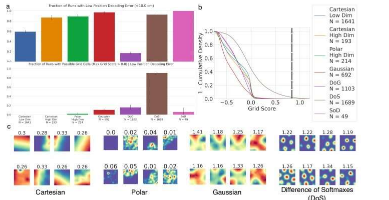

然而,麻省理工学院的研究人员发现了截然不同的结果。在对他们在路径集成方面训练的 11,000 多个神经网络进行分析时,他们发现虽然其中近 90% 成功地学习了任务,但这些网络中只有大约 10% 产生了可以归类为类似网格单元的活动模式. 这包括即使只有一个单元也能获得高网格分数的网络。

据麻省理工学院团队称,早期的研究更有可能产生类似网格单元的活动,仅仅是因为研究人员在这些模型中建立了限制。

“早期的研究已经提出了这个故事,如果你训练网络进行路径整合,你将获得网格单元。我们发现相反,你必须做出这一长序列的参数选择,我们知道这与生物学,然后在这些参数的一小部分中,您将获得所需的结果,”Schaeffer 说。

更多生物模型

早期研究中发现的限制之一是研究人员要求模型将速度转换为一个独特的位置,由一个与位置单元相对应的网络单元报告。为此,研究人员还要求每个位置细胞只对应一个位置,这不是生物位置细胞的工作方式:研究表明,海马体中的位置细胞可以对多达 20 个不同的位置做出反应,而不仅仅是一个位置。

当 MIT 团队调整模型使位置细胞更像生物位置细胞时,模型仍然能够执行路径整合任务,但它们不再产生类似网格细胞的活动。当研究人员指示模型生成不同类型的位置输出时,类似网格单元的活动也消失了,例如在具有 X 和 Y 轴的网格上的位置,或者作为相对于原点的距离和角度的位置。

“如果你要求这个网络做的唯一事情是路径整合,并且你对读出单元施加了一组非常具体的,而不是生理要求,那么就有可能获得网格单元,”Fiete 说。“但如果你放松这个读出单元的任何这些方面,就会大大降低网络产生网格单元的能力。事实上,通常它们不会,即使它们仍然解决了路径集成任务。”

因此,如果研究人员还不知道网格单元的存在,并指导模型生成它们,那么它们不太可能作为模型训练的自然结果出现。

研究人员说,他们的研究结果表明,在解释大脑的神经网络模型时需要更加谨慎。

“当你使用深度学习模型时,它们可以成为一种强大的工具,但在解释它们并确定它们是否真正进行从头预测时,甚至揭示大脑正在优化的内容时,必须非常谨慎。 ”菲特说。

伦敦大学学院定量神经科学教授 Kenneth Harris 表示,他希望这项新研究能够鼓励神经科学家在说明神经网络和大脑之间的类比可以显示什么时更加谨慎。

“神经网络可以是一个有用的预测来源。如果你想了解大脑如何解决计算,你可以训练一个网络来执行它,然后测试大脑以相同方式工作的假设。假设是否得到证实或不,你会学到一些东西,”没有参与这项研究的哈里斯说。“这篇论文表明‘postdiction’没有那么强大:神经网络有很多参数,所以让它们复制现有结果并不令人惊讶。”

麻省理工学院的研究人员说,在使用这些模型来预测大脑的工作方式时,重要的是要在构建模型时考虑到现实的、已知的生物学限制。他们现在正在研究网格细胞模型,他们希望这些模型能够更准确地预测大脑中网格细胞的工作方式。

“深度学习模型可以让我们深入了解大脑,但前提是你在模型中注入了大量生物学知识,”Khona 说。“如果你使用正确的约束,那么模型可以给你一个类似大脑的解决方案。”

免责声明:本文由用户上传,与本网站立场无关。财经信息仅供读者参考,并不构成投资建议。投资者据此操作,风险自担。 如有侵权请联系删除!